在众多AI模型中,Gemini 1.5 Pro的百万级上下文窗口堪称技术突破。这项能力让AI从“对话工具”跃升为“深度分析师”。

本文将从技术原理入手,结合实战案例,拆解如何利用这一能力处理长篇文档、复杂财报、代码库等任务,并介绍国内用户通过RskAi(ai.rsk.cn) 直接体验的完整方案。

一、长上下文的技术本质:Gemini如何做到“过目不忘”?

传统AI模型在处理长文本时,常受限于Transformer架构的平方级计算复杂度。Gemini的突破在于对注意力机制的底层优化。

稀疏注意力与滑动窗口的结合:Gemini并非在每个计算层都对所有token计算注意力,而是采用混合策略。底层使用滑动窗口注意力(只关注邻近token),捕捉局部语义;高层使用稀疏注意力(跳跃式关注关键token),捕捉全局结构。这种设计使计算量从O(n²)降至O(n√n)甚至更低,为处理百万token铺平道路。

上下文压缩技术:在预训练阶段,Gemini学习了一种隐式的“压缩”能力。当输入超长文档时,模型并非简单存储每个词,而是将其转化为高维语义向量,只保留关键信息。这类似于人脑阅读时并非背诵全文,而是理解大意和关键细节。

TPU集群的并行计算:推理时,百万token会被切分成多个片段,分配到不同的TPU核心并行处理,最后融合结果。Google的TPU网络互联带宽极高,使得跨核心通信延迟极低,用户几乎感觉不到分片处理的存在。

这些技术的综合效果是:Gemini能在几十秒内“读完”一本300页的书,并回答出第150页某个细节与第280页另一个细节之间的逻辑关联——这是此前任何商用模型都无法做到的。

二、实战场景一:深度财报分析——从PDF到投资结论

需求描述:某投资人需要分析特斯拉2025年Q4财报(PDF,约80页),提取核心财务指标、管理层讨论中的风险信号,并与前两个季度对比,形成投资建议。

传统做法:人工翻阅80页财报,摘录数据,制作对比表格,耗时3-4小时。

Gemini解法(通过RskAi实现):

上传与预处理:访问RskAi

,选择Gemini 1.5 Pro,上传PDF文件。Gemini会自动解析PDF中的文字、表格甚至图表。

分阶段指令:

第一阶段:“请提取这份财报中Q4的核心财务数据:营收、毛利率、运营利润、净利润、现金流、研发投入。用表格呈现,并与Q3数据对比(如果文中包含)。”

第二阶段:“在‘管理层讨论与分析’部分,找出所有关于‘供应链’、‘竞争格局’、‘监管风险’的表述,并总结管理层对这些风险的态度(乐观/中性/担忧)。”

第三阶段:“结合前两个季度的数据趋势(如果模型记得),分析特斯拉Q4的业绩是加速增长还是增速放缓?给出你的判断依据。”

结果输出:Gemini在2分钟内返回了完整分析,包括对比表格、风险摘要和趋势判断。投资人直接复制到自己的报告中,仅需核对关键数据。

技术要点:此处Gemini展现了两个核心能力:跨页关联(将第10页的财务数据与第50页的风险描述关联)和隐含对比(即使不提供前两个季度的原文,模型也能从预训练知识中调取常识性数据,但如果上传了前三季度财报,准确性会更高)。

三、实战场景二:代码库审计与重构建议

需求描述:开发者接手一个遗留Python项目,包含50多个文件,总代码量约2万行。需要快速理解项目架构,找出潜在bug,并给出重构建议。

传统做法:逐个文件阅读,画架构图,凭经验猜测风险点,耗时数天。

Gemini解法:

打包上传:将整个项目文件夹压缩为zip,通过RskAi上传。Gemini支持读取压缩包内的多个文件,并理解文件之间的依赖关系。

指令设计:

第一层:“请分析这个项目的整体架构,识别出主要模块和它们之间的调用关系。用Mermaid格式画出架构图。”

第二层:“在‘utils.py’和‘database.py’中,找出所有可能引发SQL注入漏洞的代码模式,并给出修复示例。”

第三层:“对比‘auth.py’和‘user.py’中对用户角色的处理逻辑,是否存在不一致?如果有,哪里是源头?”

输出与验证:Gemini生成了架构图,指出3处潜在SQL注入点,并发现认证逻辑中有一处角色定义被硬编码在两个文件中,存在维护风险。开发者据此快速定位问题,重构时间缩短70%。

技术要点:百万上下文在此场景中意味着模型能“同时看到”所有文件,理解跨文件调用,而不仅仅是片段分析。这类似于给AI装上了一双能俯瞰整个代码库的眼睛。

四、长上下文能力的横向对比与选择策略

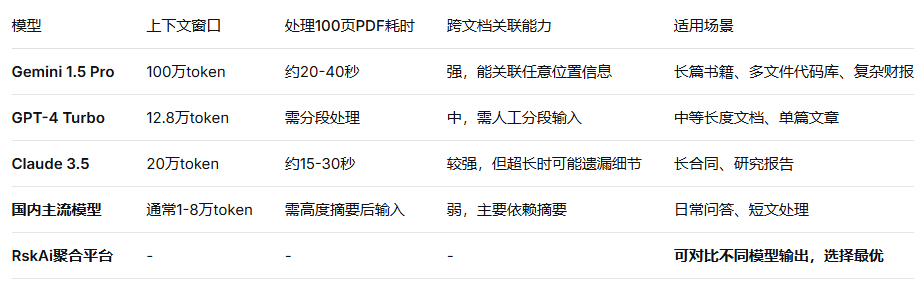

从上表可见,Gemini在超长文档处理上具有显著优势,尤其适合需要“全局理解”的任务。通过RskAi,你可以在同一界面先用Gemini处理长文档,再用GPT-4o优化语言表达,取各家之长。

五、技术向FAQ

Q1:百万token是否意味着可以输入整本《战争与和平》?如何处理小说中的人物关系?

A:理论上可以。但实际测试中,处理超长小说时,模型对早期出现但后期不再提及的次要人物可能记忆模糊。建议结合具体问题提问,例如“分析娜塔莎·罗斯托娃的性格变化轨迹”,模型会优先检索与娜塔莎相关的段落,效果更好。

Q2:Gemini的长上下文是“真理解”还是“机械检索”?

A:从实测看,它具备一定的推理能力,而非简单关键词匹配。例如在代码审计中,它能发现逻辑不一致,这是检索+推理的结合。但复杂的三段论推理仍需人工验证。

Q3:通过RskAi上传百万token文档,是否会超时或失败?

A:RskAi针对Gemini进行了适配,100万token以内的文档通常能稳定处理。但受限于服务器负载,极端高峰时可能需要排队。建议避开使用高峰期,或分批次上传。

Q4:长上下文会显著增加推理成本,RskAi的免费额度够用吗?

A:处理一次百万token确实消耗较大。RskAi的免费额度每日有限,适合低频深度分析。如果长期高频使用,建议关注平台后续的付费套餐,或结合摘要策略:先用Gemini生成摘要,再基于摘要提问,节省额度。

六、总结:让长上下文成为你的分析利器

百万级长上下文是AI从“对话式”走向“分析式”的关键一跃。它让处理整本书、整个代码库、整年财报成为可能,将AI从一个问答助手升级为深度研究伙伴。国内用户通过RskAi 可以零门槛体验这项技术,无需关心网络环境和海外支付。下一次当你面对堆积如山的文档时,不妨让Gemini替你“通读”一遍,你只需提出核心问题。

芯耀

芯耀

198

198