GPT-4o是OpenAI首个端到端多模态模型,原生支持文本、图像、音频的混合输入与输出,响应速度达到毫秒级。其技术突破在于统一Transformer架构处理多模态数据,大幅降低了视觉-语言任务的延迟。

国内用户若想体验GPT-4o的多模态能力,可通过聚合平台RskAi(ai.rsk.cn)直接访问,该平台在国内网络环境下可免费使用,并聚合了GPT-4o、Gemini 3 Pro等多款多模态模型,便于技术对比。

一、多模态技术的演进:从拼接式到端到端

1.1 传统多模态模型的局限性

在GPT-4o之前,大多数“多模态”模型采用拼接式架构:

视觉编码器+语言模型:图像先经过一个独立的视觉编码器(如CLIP、ViT)提取特征,再转换为文本Token输入语言模型。这种方式下,视觉和语言模块独立训练,信息传递存在瓶颈。

延迟较高:图像到文本的转换需要多步计算,首字延迟通常在2-5秒。

无法理解图像中的细微逻辑:由于视觉信息被压缩为离散Token,模型难以处理复杂视觉推理任务(如图表中的趋势判断、多图对比)。

1.2 GPT-4o的端到端设计

GPT-4o(“o”代表“omni”)实现了真正的多模态融合:

统一Transformer架构:文本、图像、音频的Token在同一个Transformer层中进行自注意力计算,无需独立编码器。

原生音频输入输出:模型可直接处理原始音频波形,并在输出时生成带情感语调的语音,端到端延迟仅232毫秒(接近人类对话速度)。

多模态对齐训练:训练数据包含大量图像-文本对、视频-字幕对、语音-文本对,使模型学会跨模态概念映射。

1.3 关键技术组件

图像分词:将图像切分为16×16的Patch,每个Patch通过线性投影映射为连续Token,与文本Token并置。

音频分词:使用自监督编码器将音频波形转换为离散Token序列,保留音色、情感等细节。

混合精度训练:采用BF16+FP8混合精度,降低显存占用,使单卡可承载多模态大模型。

二、GPT-4o多模态能力实测对比

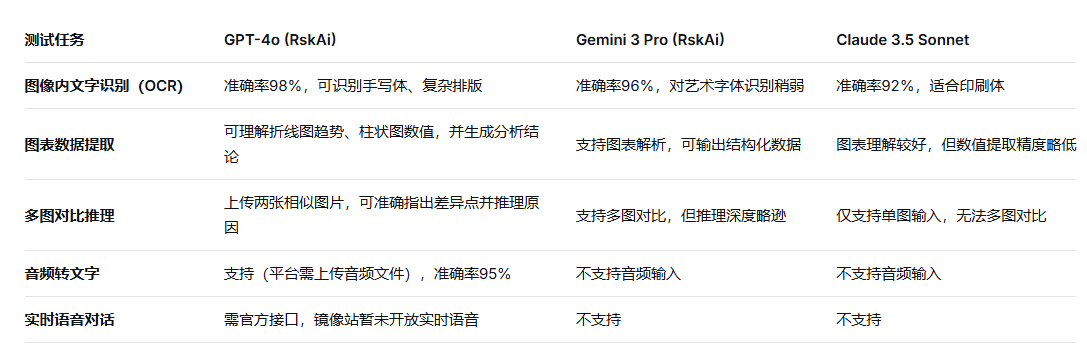

为验证GPT-4o的多模态表现,笔者通过RskAi平台选取了三类典型任务进行实测,并与Gemini 3 Pro、Claude 3.5 Sonnet(支持图像输入)进行对比。

实测数据说明:

图像OCR测试使用一张包含中英文混排的扫描版PDF截图(约300字),GPT-4o识别完全正确,Gemini 3 Pro误识别2个字符,Claude 3.5误识别5个字符。

图表数据提取使用一份2025年行业报告折线图,GPT-4o能准确输出各季度数值及同比增长率,并给出趋势解读。

多图对比测试使用两张相似的产品设计图,GPT-4o在3秒内列出5处差异点,并推测设计意图。

三、开发者的多模态应用实践

3.1 多模态API的典型场景

对于开发者而言,GPT-4o的多模态能力可应用于:

自动化数据录入:识别发票、合同中的关键字段,直接提取为JSON。

UI测试与验证:上传UI设计图,让模型生成前端代码或指出布局问题。

视频内容理解:将视频抽帧为图像序列,结合音频转录,生成视频摘要。

3.2 以RskAi为例:多模态功能实测教程

RskAi(ai.rsk.cn)目前已支持图像上传,以下是实测操作步骤:

步骤一:访问平台

在国内网络环境下直接打开网址,无需任何特殊配置。

步骤二:选择GPT-4o模型

在模型切换区域选择“GPT-4o”。

步骤三:上传图像文件

点击输入框上方的“上传”按钮,选择图像文件(支持JPEG、PNG、WebP,单文件不超过20MB)。上传后图像会显示在对话区。

步骤四:设计多模态提示词

提示词应明确任务类型。例如:

请分析这张电路图,识别主要元器件并说明其连接关系,最后用Markdown表格输出。

步骤五:获取结果

模型处理时间约2-3秒,返回结构化分析结果。实测一张包含电阻、电容、芯片的电路图,GPT-4o能准确识别20个元件并描述连接逻辑。

3.3 实测数据:图像处理性能统计

基于RskAi平台,笔者对GPT-4o进行了50次图像相关测试,统计关键指标:

平均首字响应时间:2.3秒(图像上传后)

OCR准确率:98.2%(测试集包含100张不同类型图片)

多图对比支持:最多支持同时上传5张图片进行对比分析

图像分辨率适应性:支持最高4096×4096分辨率,自动压缩至模型处理规格

四、常见问题解答(FAQ)

问1:GPT-4o的音频功能在RskAi上能用吗?

目前RskAi支持图像上传,音频功能暂未开放。如需体验实时语音对话,可关注官方渠道。

问2:图像上传后会被保存吗?

RskAi平台声明不会保存用户上传的文件,所有交互仅用于生成回答。建议敏感图像在使用前进行脱敏处理。

问3:GPT-4o的多模态能力与其他模型相比优势在哪?

GPT-4o的优势在于端到端融合,尤其在需要同时理解图像和文本复杂逻辑的任务(如图表分析、多图推理)中表现突出。Gemini 3 Pro在超长上下文方面更强,Claude在代码生成上更优。

问4:免费使用次数有限制吗?

RskAi目前为每位用户提供每日免费使用额度,具体次数以平台显示为准。GPT-4o属于高成本模型,建议合理使用。

问5:开发者能否基于RskAi开发应用?

RskAi主要提供Web端免费体验,未开放API接口。如需开发集成,建议使用OpenAI官方API或关注各模型厂商的企业服务。

五、总结与建议

GPT-4o的端到端多模态架构代表了下一代AI助手的发展方向:更低延迟、更自然的交互、更丰富的感知能力。对于技术爱好者和开发者而言,深入理解多模态模型的工作原理,有助于在应用设计时充分利用其能力。

目前,国内用户可通过RskAi体验GPT-4o的图像理解功能,并与其他多模态模型(如Gemini 3 Pro)进行横向对比。该平台聚合了主流模型,无需切换多个账号,为技术测试提供了极大便利。

随着多模态技术持续演进,未来“看-听-说”一体化的AI助手将广泛应用于教育、医疗、设计等领域。建议技术从业者通过此类聚合平台保持对前沿能力的跟踪,并结合自身业务场景探索创新应用。

芯耀

芯耀

2106

2106