大部分教程都在教你怎么"一次问一个问题",但实际工作中,真正的效率瓶颈往往是重复性任务——10 篇产品文案要出、50 份报告要总结、上百条用户反馈要归类。单条对话根本扛不住这种量级。

Gemini 3.1 Pro 的大上下文窗口和 API 批处理能力,让这类任务从"不可能手动搞"变成了"脚本跑一遍就行"。今天分三个场景讲:批量生成文案、批量总结文档、批量整理信息。

一、批量生成文案:结构化 prompt 是核心

很多人用 AI 写文案的方式是一条一条发 prompt,改一个变量发一次。10 条还行,50 条就崩溃了。

正确的做法是"模板 + 数据源"批量驱动。

网页端最快的方式: 把所有素材整理成一个表格格式(CSV 或直接在对话里贴),然后用一条 prompt 控制全部输出。

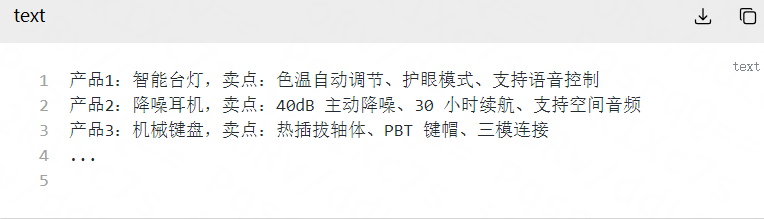

比如你需要给 20 个产品各写一段 100 字的卖点文案,风格统一但内容不同。先把产品信息整理成这样的结构:

然后给 Gemini 的 prompt 写清楚:

一次出 20 条,质量稳定,风格统一。如果有个别不满意,单独追问微调就行。

API 层面的批量更狠。 用脚本读取数据源(Excel、数据库、API 接口),循环调 Gemini 接口,每条请求带不同的产品参数。加个异步队列控制并发数,一分钟能跑上百条。

二、批量总结文档:NotebookLM + API 的双轨策略

这是 Gemini 3.1 Pro 相比其他模型拉开差距最大的场景之一——百万级 token 的上下文窗口,让它能一次性吃进大量文档。

场景一:短文档批量总结(10-50 篇)。 把 PDF 或 Word 文件打包上传到 NotebookLM,Gemini 会自动建立索引。然后直接问"帮我把这些文档按主题分类,并为每篇写一段 200 字摘要"。它能跨文档识别主题重叠,合并相似内容,避免重复总结。

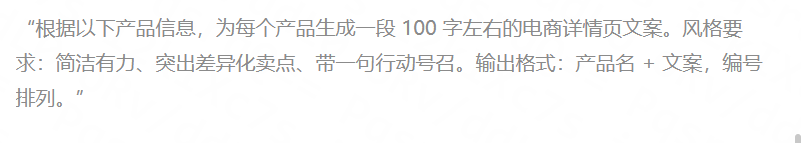

场景二:长文档深度总结。 一份几百页的技术规范或者年度报告,丢给 Gemini,让它输出结构化摘要。关键 prompt 写法:

第三条特别有价值。Gemini 3.1 Pro 的推理能力在 3.0 基础上提升明显,找出文档内部矛盾的能力比上一代强了一截。

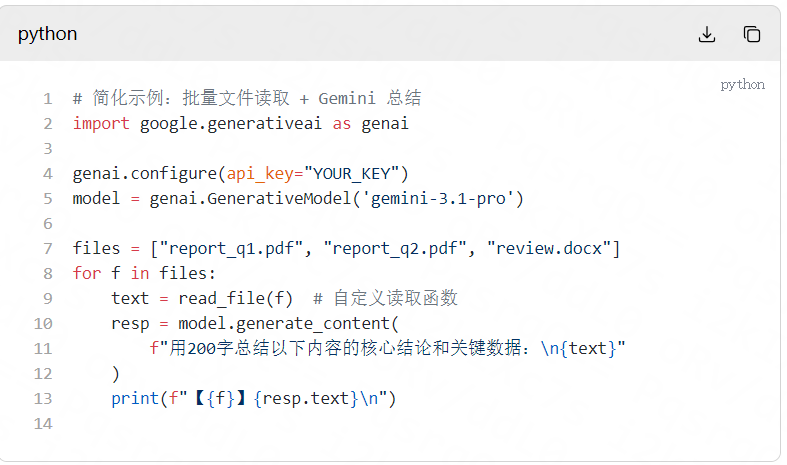

场景三:批量处理混合格式。 真实场景里,你手里可能是 10 份 PDF、5 个 Word、3 个 Excel、还有几个网页链接。手动一份份上传太蠢,这时候用脚本就对了。

基本流程:用 Python 把所有文件统一转成文本(PDF 用 PyPDF2、Word 用 python-docx、网页用 requests + BeautifulSoup),然后拼成一个大 prompt 调 Gemini API。注意控制每次请求的 token 数别超窗口上限,超了就分批。

跑一遍,所有文档的摘要就全出来了,可以直接粘进报告或者写进数据库。

三、批量整理信息:从混乱到结构化

这是内容运营和数据分析师最头疼的活——把一堆半结构化的原始信息整理成规整的数据。

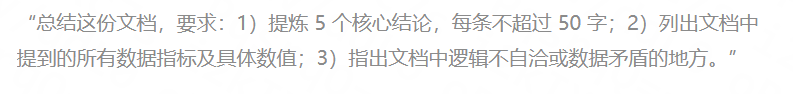

典型场景:用户反馈归类。 比如 App Store 评论区有 500 条评价,你要按"功能建议""Bug 反馈""使用体验""其他"四个维度分类,还要统计每个类别的数量和典型原文。

手动分?开玩笑。用 Gemini 批量处理:

分批发,每批 50-80 条,几轮就跑完了。拿到 JSON 结果后,用 pandas 或者 Excel 做二次统计就行。

另一个场景:竞品信息整理。 手里有 10 个竞品的官网介绍、产品文档、用户评价,让 Gemini 统一提取关键字段:

这种"非结构化输入 → 结构化表格"的转换,是 Gemini 3.1 Pro 的强项。它的大上下文能同时记住所有竞品信息,做横向对比时不会丢上下文。

批量处理这块,社区里也积累了不少实战经验。像 t.myliang.cn 上就有用户分享的批量 prompt 模板和踩坑记录,尤其是关于 token 控制和错误重试的处理,比自己摸索快不少。

四、几个容易踩的坑

Token 控制。 3.1 Pro 的上下文窗口虽然大,但单次请求有上限。批量处理时一定要提前估算 token 数,超了就分批,别等报错了再改。

输出格式不一致。 批量生成时,偶尔会出现个别条目格式偏移的情况(比如要求 JSON 输出但返回了 Markdown)。解法是在 prompt 末尾加一句"严格按 JSON 格式输出,不要附加任何解释文字",能压到 95% 以上的格式一致率。

重复调用的成本。 API 批量跑是有成本的。如果是简单任务(比如分类、提取关键词),可以考虑用 Gemini Flash 替代 Pro,速度更快、费用更低,质量损失在简单任务上几乎感知不到。

五、趋势:AI 批处理正在替代"人工搬运"

从行业视角看,批量处理能力是 AI 从"玩具"变成"工具"的关键分水岭。

单条对话能解决的是"点"的问题,批处理解决的是"面"的问题。当一个模型能稳定地处理上百条任务、输出格式统一、错误率可控,它才真正具备了替代重复性人力工作的资格。

Gemini 3.1 Pro 在这个方向上的优势很明显:大上下文 + 多模态 + 强结构化输出能力,三者叠加让它在批处理场景下几乎没有短板。Claude 在长文本理解上很稳,但批处理工具链的成熟度不如 Google 生态;GPT-4o 的 API 易用性不错,但上下文窗口和多模态协同能力稍逊。

未来半年,我判断会有越来越多的"AI 批处理工作流平台"出现——不需要写代码,拖拽配置就能跑批量任务。Google 在这个方向上的布局最深,Vertex AI + Workspace 的组合已经初具雏形。

对普通用户来说,现在的最佳策略是:先在网页端用批量 prompt 跑通流程,验证效果;再用 API 脚本实现自动化,把重复劳动彻底干掉。

芯耀

芯耀

666

666