上周Gemini更新了交互式3D模型生成和实时物理模拟能力,输入一句描述就能生成可交互的动态场景。同时三星宣布2026年将在8亿台移动设备上部署Gemini,Google I/O也定档5月。AI模型正在从纯软件走向硬件终端,这对做嵌入式和硬件开发的人来说,信号很明确:AI工具链已经不是"锦上添花",而是"不学就掉队"。

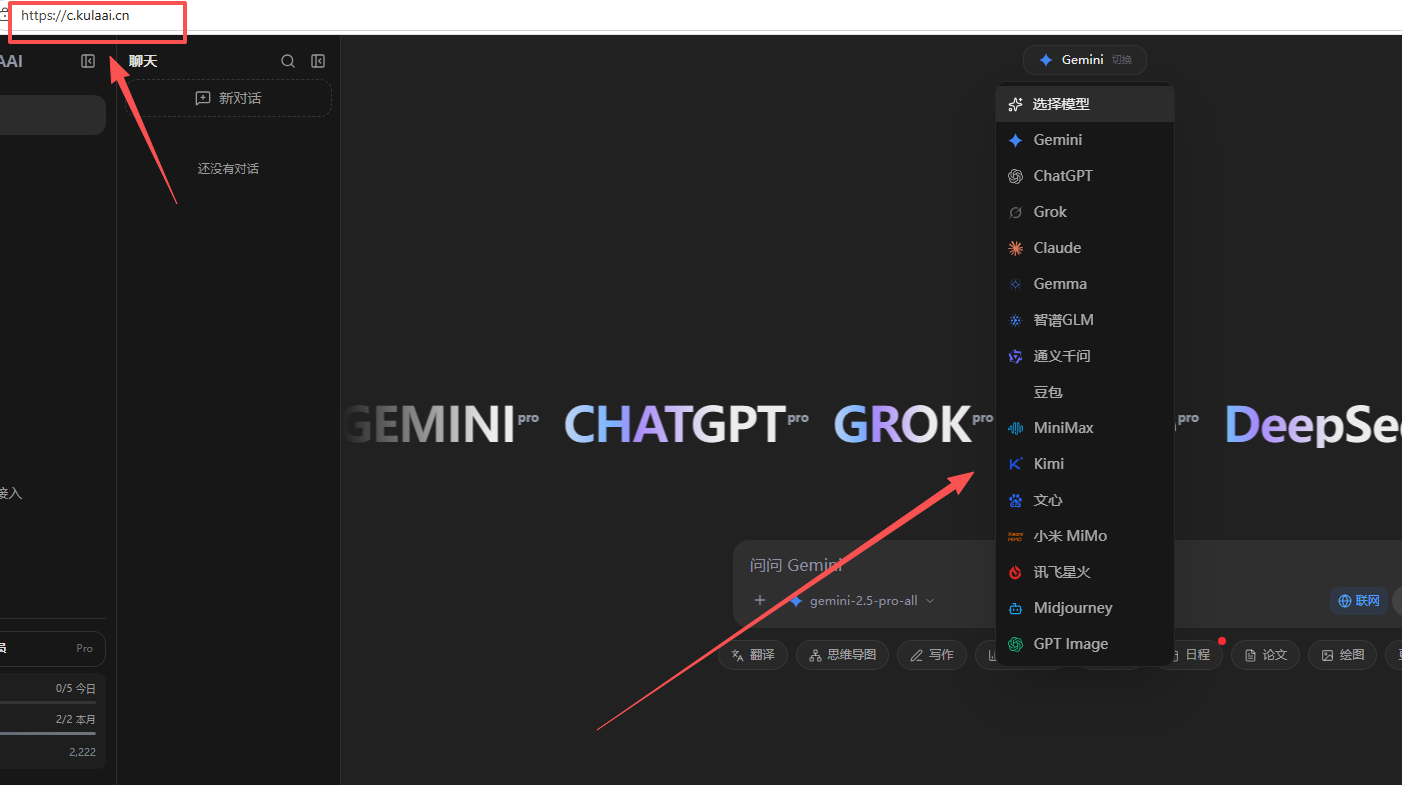

今天这篇聊聊Gemini到底怎么上手,以及在硬件开发场景里能干什么。如果不想逐个摸索接入方式,AI模型聚合平台库拉c.kulaai.cn可以直接用,Gemini、ChatGPT、Claude都在一个界面里,注册完就能切着跑,省掉大量折腾时间。

Gemini对硬件开发者有什么用?

先说个很多人忽略的点:Gemini的多模态能力,对硬件工程师其实非常实用。

看电路图。丢一张原理图截图进去,Gemini能识别元件、分析信号流向,甚至指出潜在的设计问题。当然不能替代专业review,但作为初筛工具已经够用了。

读datasheet。几百页的芯片手册,直接丢进去让它提取关键参数、对比不同型号的规格差异,省掉大量翻文档的时间。

代码辅助。嵌入式C/C++、Python脚本、Verilog片段,Gemini都能写。虽然不能直接上产线,但写个测试脚本、串口调试工具、数据采集程序,效率提升很明显。

多模态调试。拍一张PCB板的实物图,让Gemini识别焊接问题或者元件布局问题,虽然准确性还有限,但作为辅助手段已经能用。

三种上手路径

路径一:聚合平台,最快跑通

有人帮你把各家模型的接口封装好了,你选个模型直接对话就行,不用管底层怎么接的。

这种方式最适合"先用起来再说"。注册完选Gemini直接跑,随时切ChatGPT和Claude对比。实际开发中,同一个问题跑三个模型,挑最靠谱的那个答案用。

选平台看三点:模型版本新不新,Gemini迭代很快,新旧版本差距大;延迟稳不稳,高峰别卡半天;计费透不透明,按次还是包月,按自己用量选。

注意:涉及产品设计和业务敏感数据,别在公开平台上跑,这是底线。

路径二:API调用,工程师首选

有编程基础的话,走Google AI Studio的API是正路子。拿到key,装好SDK,几行代码就能调用Gemini。

我自己用API做过几个项目:批量解析芯片datasheet提取参数表、根据原理图描述自动生成测试用例、数据采集脚本的日志分析。准确率和速度都能接受,按token计费用量大反而比网页版便宜。

核心优势是能嵌进自己的工作流。接到IDE做代码补全,嵌到测试框架里做自动化分析,搭内部知识库做技术问答,API方式都能实现。

两个坑:网络环境要能稳定访问Google服务端点,服务器在国内得提前处理;免费层QPS很低,正式用必须升级付费计划。

路径三:原生Gemini,功能最全

直接用Google原生版本,功能最完整。搜索联动、Workspace深度整合、最新的3D模型生成和物理模拟,这些是其他方式给不了的。

如果你本来就用Google全家桶做项目管理,原生体验的衔接感最丝滑。Gemini嵌在Docs里写技术文档、在Drive里整理datasheet,用起来确实顺手。

但成本最高。能稳定访问Google是硬性前提,拦住大部分人。Google账号国内注册也频繁出问题。

所以这条路适合本身已经是Google重度用户的人。纯粹为了Gemini从零搭环境,性价比不行。

趋势判断

2026年的AI工具格局正在从"一家独大"变成"各有所长"。ChatGPT份额跌破40%,Claude日活暴涨848%,Gemini靠多模态和硬件生态抢市场。

对硬件开发者来说,几个趋势值得关注:端侧AI加速落地,三星8亿设备部署Gemini只是开始,后续芯片厂商对模型推理的硬件适配会越来越多;多模态能力会成为标配,图片理解、物理模拟这些能力对硬件设计的价值会持续释放;API生态成熟度在提升,开发者接入门槛在降低。

踩坑经验

第一,别纠结太久。2026年AI工具迭代极快,先跑起来比什么都重要。

第二,多模型对比。不同任务适合不同模型,代码问题找Claude,多模态找Gemini,通用问答ChatGPT也还行。别绑死在一个模型上。

第三,关注硬件生态动态。Google I/O五月就要开了,Gemini在硬件端的能力预计还有大更新,值得跟进。

第四,数据安全。不管用哪种方式,涉及产品的敏感信息别在公共平台上处理,这是底线。

AI工具已经不是"要不要用"的问题了,而是"怎么用好"的问题。先跑起来,边用边调,工具是拿来提效的。

芯耀

芯耀

1344

1344