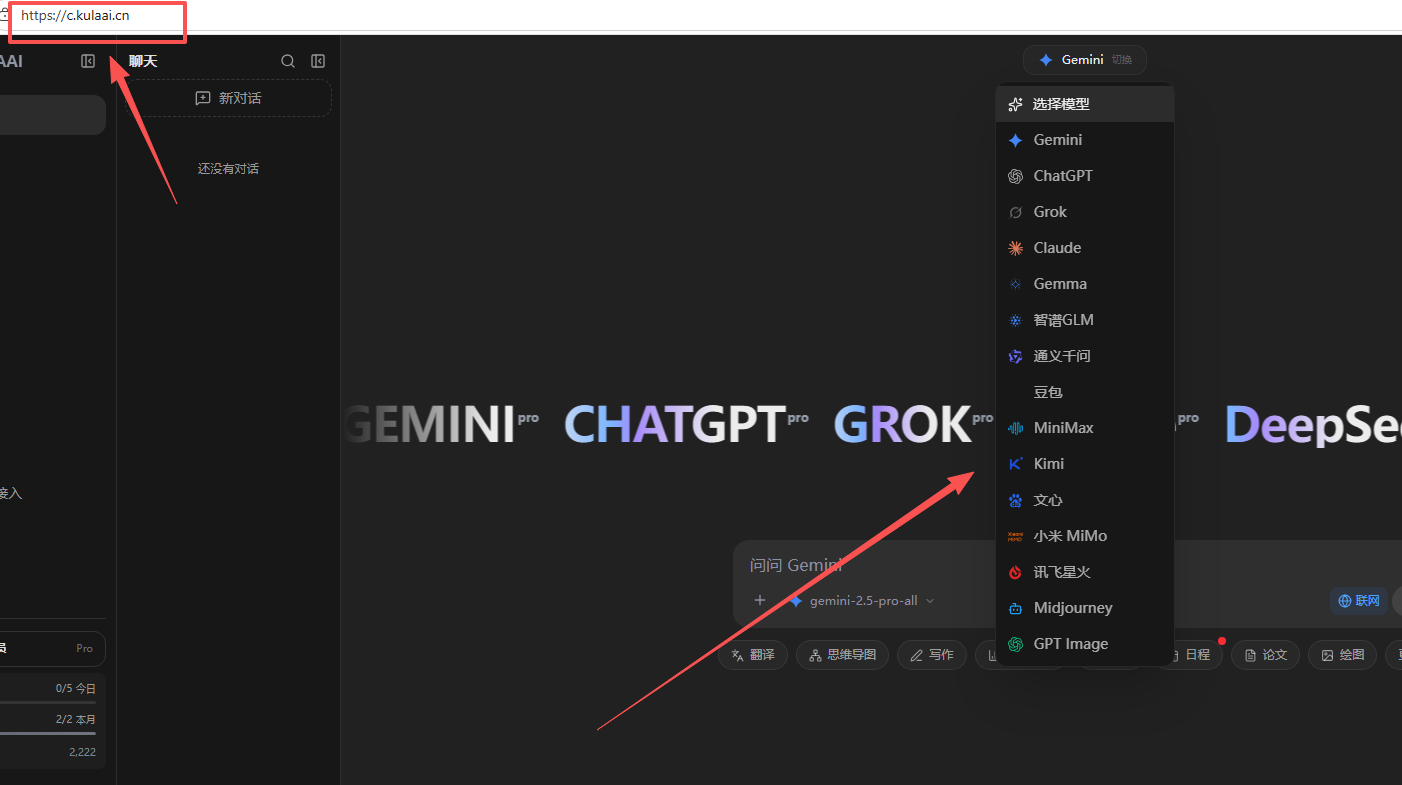

最近在整理团队的AI推理方案选型报告,需要同时测试多个云侧大模型的表现。库拉(c.kulaai.cn)这个聚合平台省了我不少事——Gemini 3.1 Pro、GPT-5.4几个模型都在一个界面里,不用分别对接不同供应商的API,做横向对比方便很多。

今天主要聊Gemini 3.1 Pro。不只是从软件角度说它有多强,也想从算力和推理架构的视角聊聊——这对做硬件选型和系统集成的人可能更有参考价值。

3.1 Pro的推理架构到底变了什么

先看一个关键数据:ARC-AGI-2测试。这个基准专门衡量模型在未知任务上的泛化推理能力,不能靠训练集刷分。Gemini 3.1 Pro从3 Pro的约47%提升到了接近69%。

22个百分点的跳跃,在大模型发展史上是非常罕见的单版本跨越。

谷歌没有公开3.1 Pro的完整技术细节,但从已有的分析来看,核心变化大概率出在推理时计算分配机制上。之前的模型在推理阶段的计算量是相对固定的,而3.1 Pro似乎引入了动态计算深度——简单问题走浅层推理,复杂问题自动激活更深的推理链。

这个思路其实跟端侧NPU的设计哲学有异曲同工之妙。高通的Hexagon NPU、联发科的APU、苹果的Neural Engine,都在追求"按需分配算力"——不同复杂度的任务调用不同层级的计算单元,避免把所有任务都扔进最重的流水线里。

3.1 Pro在云端把同样的逻辑跑通了,只不过规模大了几个数量级。

200万token上下文意味着什么:从存储到计算的工程挑战

3.1 Pro支持200万token的上下文窗口。这个数字在用户体验层面意味着"可以一次性扔进一整本书",但在工程层面,背后是巨大的存储和计算压力。

粗算一下:200万token对应的KV Cache(键值缓存)在FP16精度下大约需要200-400GB显存。这意味着Google在推理集群上一定做了大量显存优化工作,很可能是通过分层缓存+按需加载的混合架构来实现的。

这对硬件选型也有启发。做端侧部署的人经常纠结"我到底需要多大的显存来跑一个推理模型",3.1 Pro的答案是:不要死磕单卡显存,要在架构层面做分层管理。

实际上,Gemma 4开源系列已经在践行这个思路了。Gemma 4-26B MoE版本在推理时只激活部分专家参数,等效计算量远低于同参数量的Dense模型。这让26B级别的模型在消费级GPU上也能跑出不错的吞吐量。

跟GPT-5.4、Claude的推理效率对比

单纯比"谁更准"意义不大,三家在大多数任务上的差距已经很小了。更值得关注的是推理效率——同等任务质量下,谁消耗的计算资源更少。

根据我近两个月的实测数据,同样一个需要多步推理的技术方案评审任务:

Gemini 3.1 Pro:首次推理耗时约4.2秒,token消耗约3800,输出质量高

GPT-5.4 Thinking:首次推理耗时约5.8秒(含Thinking推理时间),token消耗约5200,输出质量高

Claude Opus 4.6:首次推理耗时约3.6秒,token消耗约3100,输出质量中上

3.1 Pro在"推理深度"和"计算效率"之间找到了一个比较好的平衡点。GPT-5.4 Thinking的推理质量也很高,但Thinking模式的额外计算开销让它的综合效率偏低。Claude胜在响应速度,但在需要深度推理的场景下表现不如前两者。

这个差异如果放大到企业级的推理集群层面,直接影响的就是推理成本和硬件采购规模。

2026年算力市场的结构性变化

聊模型绕不开算力。2026年的算力市场有两个趋势值得硬件从业者关注。

第一,推理算力需求正在超越训练算力。 NVIDIA在近期的GTC大会上披露,2027年AI推理算力需求仍将保持强劲增长。GTC 2026上发布的Rubin架构进一步强化了推理性能,Blackwell平台的GB200 NVL72已经在大规模部署中。这些硬件规格的提升直接服务于推理场景——因为大模型部署已经从"训练为主"转向"推理为主"。

第二,Token定价从降价转向涨价。 2024年各家疯狂打价格战,token按"厘"计价。但到了2026年,算力成本压力传导到终端,模型厂商和云厂商开始集体提价。《中国科学报》4月初的分析称之为"Token经济学的风向突变"。

这意味着什么?意味着算力效率不再是"锦上添花",而是直接决定商业模型能不能跑通的关键变量。

对做边缘推理芯片和加速卡的厂商来说,这其实是一个好消息。当云端推理成本上升,端侧和边缘侧的推理方案就有了更大的价值空间。Gemma 4这样的开源模型让端侧部署成为可能,而端侧部署又需要高效的NPU和推理加速硬件——这是一条完整的产业链。

边缘推理和云端推理的协同

很多人把"云端大模型"和"端侧小模型"对立起来看,觉得是非此即的关系。但2026年的实践已经证明,最优解是混合架构。

一个典型的工业场景:工厂的质检系统用端侧NPU跑Gemma 4-2B做实时缺陷检测,发现复杂异常时自动把数据上送到云端调用Gemini 3.1 Pro做深度分析。端侧负责速度,云端负责精度,两者协同。

3.1 Pro的200万token上下文在这种场景下的价值就体现出来了——端侧设备上传的大量历史数据可以一次性被云端模型消化,不需要分批处理和拼接。

这个架构模式在智能制造、自动驾驶、智慧安防等领域已经有了不少落地案例。做硬件的人应该关注的不只是"哪个模型最强",而是"怎么把不同层级的算力和模型组合成一个最优系统"。

选模型的底层逻辑

说到底,模型选择的核心问题是成本-收益权衡。

Gemini 3.1 Pro的推理能力目前最强,但token成本也是最高的。如果一个任务用Gemma 4-2B就能解决90%的准确率,何必用3.1 Pro去换那10%的提升?

成熟的工程团队都应该建立自己的模型分层体系:简单任务用轻量模型,中等任务用中端模型,只有真正需要深度推理的场景才上顶级模型。这样既能保证产出质量,又能把推理成本控制在合理范围内。

3.1 Pro是天花板,但不是日常。这个认知很重要。

写在最后

Gemini 3.1 Pro代表了2026年云端大模型推理能力的最高水平,这一点没什么争议。但从产业视角看,它的价值不仅在于模型本身有多强,更在于它所代表的推理架构进化方向——动态计算、长上下文、高效推理——这些技术最终会渗透到整个算力产业链,从云端GPU到端侧NPU,从数据中心到边缘设备。

对我们做硬件和系统集成的人来说,理解模型的推理机制,才能做好底层算力的规划和选型。

模型在上层变,算力在底层跟。这两条线的交汇点,就是2026年AI产业最有价值的地方。

芯耀

芯耀

1069

1069