AI芯片从技术驱动向商业驱动发展。短期内,市场对AI的关注点仍将是:应用场景和落地节奏。一些带来高增长的应用场景已经浮现,与非研究院预测2022年AI芯片仍将继续加速落地。

应用场景方面,三大方向值得关注:数据中心/HPC、汽车以及XR为代表的应用领域;落地节奏上,可基于AI“新三要素”来判断:产品、方案、工程化的成熟度,随着行业对AI的理解逐渐加深,行业know-how的积累渐进形成,产品、方案与需求端的契合度将越来越高,工程化过程有望加快。

对半导体市场来说,人工智能是未来十年增长的关键驱动因素之一,相应的,半导体公司也需要制定人工智能的相关战略,特别是在软件的打造、以及面向垂直细分应用的创新能力。

数据中心是主要增长来源

云计算数据中心是AI芯片典型的云端应用场景。在消费互联网、工业互联网、5G、人工智能等多重需求强势推动之下,全球数据中心需求维持在15%~20%的高速增长,中国市场则更是超过了30%。随着个人电脑市场逐渐饱和,爆发式增长的数据中心需求成为了全球半导体市场的主要增长来源。

过去几年,深度学习应用构成了数据中心工作量的很大一部分,云服务提供商成为首批采用深度学习技术的用户,用它来改进网络搜索、语言翻译、电子邮件过滤、产品推荐等,提升服务质量、效率和成本。并且,在高性能计算(HPC)应用中也采用深度学习处理大量数据和大型的模型。

AI运算其实是运行以深度学习为代表的神经网络算法,需要系统能够高效处理大量非结构化数据(文本、视频、图像、语音等) ,需要硬件具有高效的线性代数运算能力。AI计算任务具有:单位计算任务简单,逻辑控制难度要求低,但并行运算量大、参数多的特点。对于芯片的多核并行运算、片上存储、带宽、低延时的访存等提出了较高的需求。

随着模型的复杂程度和数量呈指数级增长,对算力提出了极大挑战。数据中心传统x86架构CPU处理器虽然在处理一般工作负荷——尤其是基于一定规则的工作方面,性能较为突出,但已经难以满足AI算法的并行计算要求。GPU、FPGA、ASIC以及Arm架构的CPU已在数据中心、HPC领域展现出了实力,可以说,目前正处于计算架构体系未来十年巨变的前夜。

GPU一骑绝尘

GPU的崛起源自2015年前后深度学习在产业界的爆发,它作为计算机显卡的核心,承担着图像处理和输出显示的任务。随着市场需求的发展,GPU不止用于处理图形图像,其技术原理决定了它适用于大批量处理特定类型信息,且并行计算能力和能效远远超过CPU,所以逐渐衍生出了通用计算GPU(GPGPU),即利用图形处理器进行非图形渲染的高性能计算。超算、大数据处理、人工智能等对算力要求非常高的应用场景中,算力大都采用CPU+GPGPU或搭配专用加速芯片的构建方式。

目前在集成GPU市场,英特尔、英伟达、AMD三分天下;独立GPU领域,几乎是英伟达和AMD的天下,前者市场份额甚至超出2/3。NVIDIA已经将AI能力作为其处理器战略的一部分大力推广,并不断促进AI在数据中心的应用。

我国GPU技术领域起步较晚,厂商数量并不多,既有面向云端市场、人工智能的厂商,也有在图形GPU领域寻求突破的创业者。第一类厂商目前走在最前沿,也获得了资本市场更多的关注。

国内主流GPU厂商及最新产品动态

国内主流GPU厂商及最新产品动态

来源:与非研究院

从生态与落地来看,英伟达目前处于垄断地位。国产GPU要实现大规模商用,可借鉴英伟达CUDA平台已被广泛认可的经验,开发者能很方便地通过使用软件语言实现运算加速,积累了良好的编程环境。未来,GPU领域国产化的市场空间超过50亿美元,而最重要的就是软件和开发者生态。

CPU格局微变

尽管英伟达凭借GPU加速在云端训练市场占据主导地位,但同时也在用新的架构实现加速功能,并解决x86体系结构中更深层的数据传输等问题。

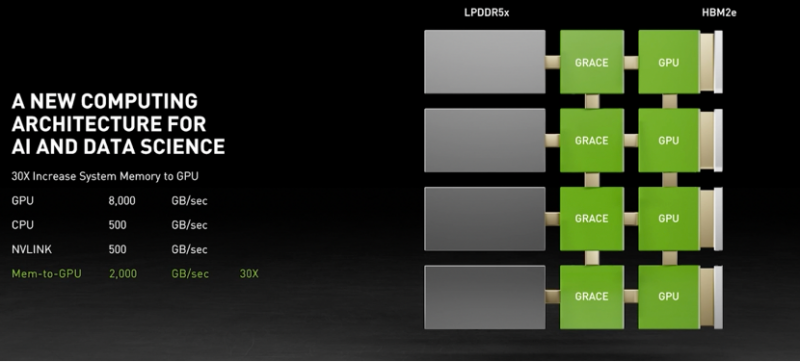

英伟达已经宣布了基于Arm的数据中心CPU,命名为Grace,将于2023年面世,专为TB级加速计算而设计。基于Arm下一代服务器IP的Grace,可与英伟达GPU紧密结合,计算性能进一步得到提升。下图是英伟达通过直连CPU,使得每个GPU都有了专用通道的设计构想。

英伟达对新计算架构的设计

来源:英伟达官方资料

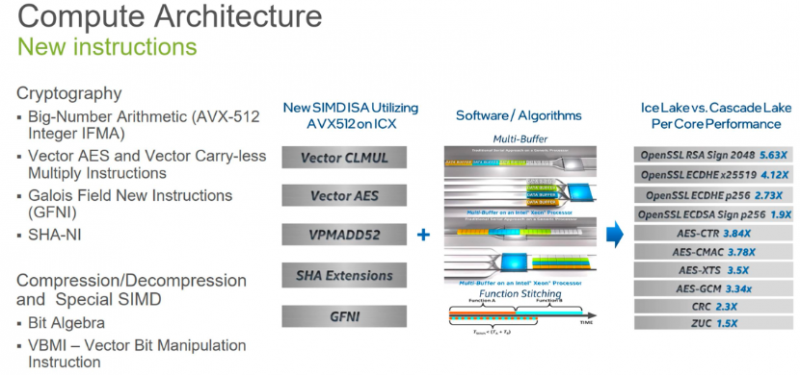

Intel方面,也已经在第三代至强可扩展处理器Ice Lake中支持AI,至强是Intel目前唯一一个内置AI加速的数据中心处理器,通过Intel深度学习加速技术来加速。在Ice Lake和新一代的产品上,做了新的插槽优化和整体解决方案来充分利用至强内置加速器,以实现更好的性能提升,推理能力提高了74%。

第三代至强可扩展处理器计算新架构和新指令

来源:英特尔官方资料

Arm崛起

相比x86架构,Arm更灵活,功耗更小、耗电量更低,未来潜力开始在高性能计算场景展露头角,包括新款Macbook Pro中采用了苹果自研基于Arm架构的M1芯片,以及云服务商巨头亚马逊自研的Arm 的服务器CPU 芯片Graviton。根据ARK Investment的预测,Arm服务器CPU市场将从2020年的不到10亿美元,增长到2030年的1000亿美元,甚至高于今天的x86。

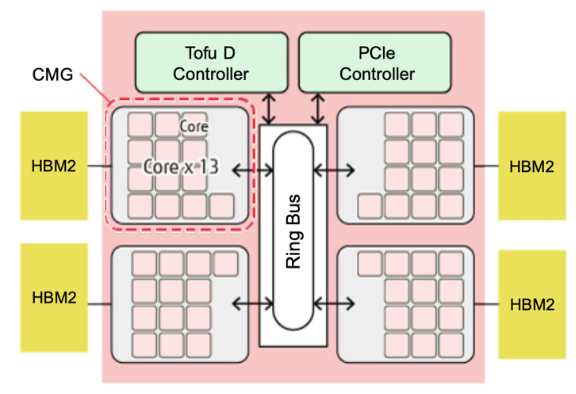

Arm架构处理器在高性能计算的应用,一个典型例子就是富士通的富岳Fugaku超级计算机,运算速度达442 petaFLOPS。

富士通 A64FX CPU 功能框图

来源:富士通官方资料

随着向5nm和3nm的迁移以及Armv9的采用,富士通CPU的能力可能会比A64FX增加一个数量级或更多。此外,与A64FX相关的体系架构概念可能会在未来的主流数据中心以及超级计算机中使用。

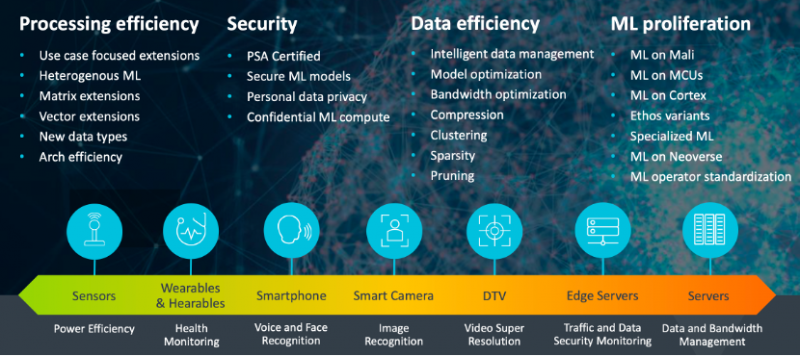

Arm自身也在加紧进行体系结构的创新,2021年宣布推出了新的Armv9体系结构,基于Armv8的基础,Armv9增添了针对矢量处理的DSP、机器学习、安全等这三个技术特性。此外,Armv9一个很重要的特点就是可伸缩矢量扩展(SVE2),SVE2增强了对在CPU上本地运行的5G系统、虚拟和增强现实以及ML工作负载的处理能力。

Armv9架构新特性

来源:Arm官方资料

国产CPU目前正处于奋力追赶的关键时期,以飞腾、鲲鹏、海光、龙芯、兆芯、申威等为代表。阿里旗下平头哥在2021年推出了首款通用CPU芯片,基于Arm v9架构,目前主要用于阿里云数据中心。

国内主流CPU厂商

来源:与非网研究院

DPU:横空出世的第三大算力支柱

除了GPU、CPU的创新,数据中心芯片路线图中的一个新角色就是DPU。

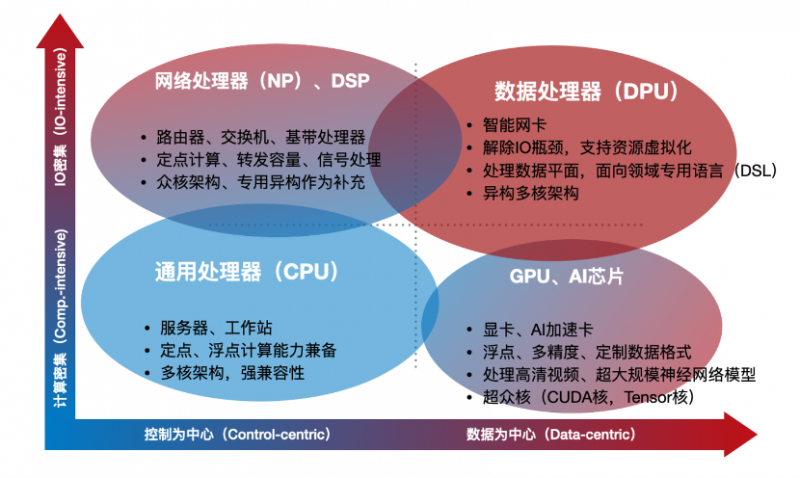

DPU(Data Processing Unit)是近年来发展起来的一种专用处理器。2020年英伟达发布的DPU产品战略中将其定位为数据中心继CPU和GPU之后的 “第三颗主力芯片”,掀起了一波行业热潮。

DPU要解决的核心问题是基础设施的“降本增效”,即将“CPU处理效率低下、GPU处理不了”的负载卸载到专用DPU,提升整体计算系统的效率、降低整体系统的总体拥有成本(TCO)。新一代的DPU不仅可以作为运算的加速引擎,还具备控制面的功能,能够运行Hypervisor,更高效的完成网络虚拟化、I/O虚拟化、存储虚拟化等任务,彻底将CPU的算力释放给应用程序。

不同类型的处理器的特征结构

来源:专用数据处理器 (DPU) 技术白皮书

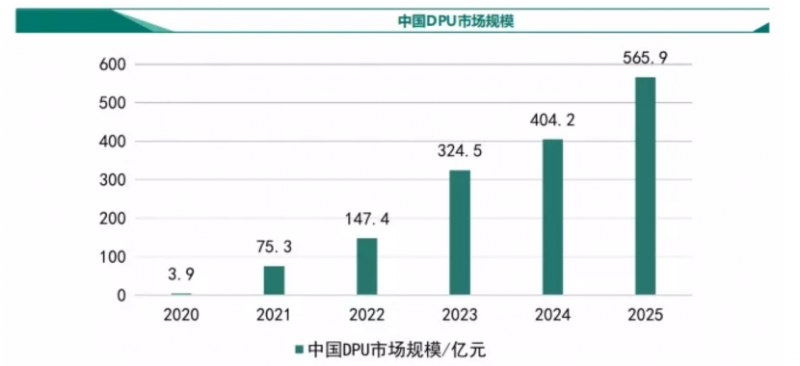

我国DPU市场规模呈现逐年增长的趋势,预计将在2022-2023年迎来爆发式增长,并在2024-2025年保持平稳,预计到2025年规模将超过565.9亿元。从市场需求侧来看,我国拥有强大的互联网产业和生态,正是因为数据的爆发,推动了对算力的需求,数据中心与云计算领域是DPU最大的应用市场。此外,DPU在确保网络安全方向有优势,从数据安全到数据中心安全都可覆盖,具备较大的发展潜力,这也是DPU发展的前提。

我国DPU市场规模预测

来源:赛迪顾问

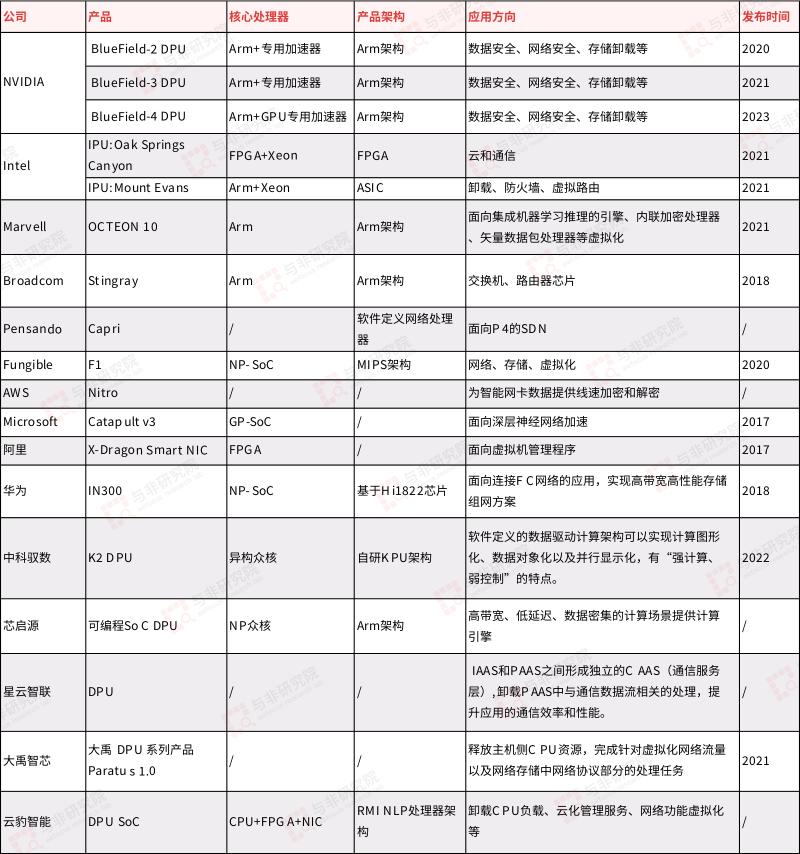

DPU当前正处于百家争鸣的阶段,各家的实现方式差别较大,有基于通用处理器核的方式,有基于可编程门阵列FPGA的方式,也有基于异构众核的方式,未来发展应用还有待探索。

国内外DPU厂商及产品

来源:与非研究院

高端FPGA驶向加速计算蓝海

FPGA(Field Programmable Gate Array,现场可编程门阵列)芯片,是在PAL(可编程逻辑阵列)、GAL(通用阵列逻辑)、CPLD(复杂可编程逻辑器件)等传统逻辑电路和门阵列的基础上发展起来的半定制芯片,具有现场可编程性,既解决了半定制电路的不足,又克服了原有可编程器件门电路数有限的缺点。

与CPU、GPU、ASIC 等芯片相比,核心区别在于其底层逻辑运算单元的连线及逻辑布局未固化,适用于底层算法需要持续更迭的运算领域,具有灵活、可快速开发、延迟低等优点。面向人工智能等新兴技对算力的加速需求,FPGA的显著优势就是能够根据不同工作负载进行加速。据 Market Research Future 数据,2018年全球FPGA市场规模为63.35亿美元,预计2025 年将增长至125.21亿美元,2018-2025年平均复合增长率为10.22%。

FPGA在数据中心主要用作加速处理,通常与CPU搭配,起到加速卡的作用,把CPU的部分数据运算卸载至FPGA,部分实时处理/加速定制化的计算由 FPGA 执行。据 Frost & Sullivan 数据显示,2020 年应用于该领域的 FPGA 芯片,在中国销售额将达到5.8亿元,预计2025 年将增长至 12.5 亿元,成长空间广阔。此外,企业级工作负载加速应用将继续驱动FPGA的应用,新的架构正在数据中心产生及应用,这是FPGA所面临的蓝海。

面向云端市场,赛灵思(已被AMD收购)的7nm芯片平台Versal Premium,是基于自适应计算加速平台(ACAP)的产品,专为在散热条件和空间受限的环境下运行最高带宽网络,以及需要可扩展、灵活应变应用加速的云提供商而设计。Versal Premium具有片上可编程网络,可以在逻辑器件和连接界面之间实现高速通信而无需额外的资源,解决了传统高性能、高带宽设计遇到的瓶颈。

Versal Premium架构

来源:赛灵思官方资料

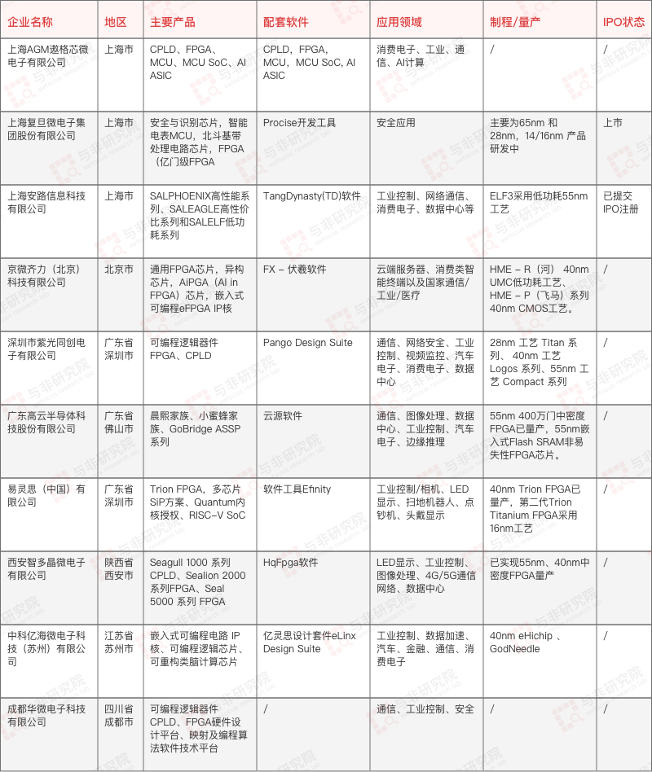

我国FPGA市场需求量全球最大,占全球市场的30%以上,市场空间约为100亿人民币,主要应用于数据采集和接口、高性能视频解码等领域。国产FPGA过去多用于中低端市场,伴随5G、AI、自动驾驶、医疗、工业等发展,未来具有较大的增长空间。

国内主要FPGA厂商概况

来源:与非网研究院

ASIC百花齐放

ASIC(Application Specific Integrated Circuit),特殊应用集成电路芯片,是一种根据特定算法定制的芯片架构,其定制程度相比于GPU和FPGA更高。ASIC 算力水平一般高于 CPU、GPU、FPGA,但初始投入大、专用性强,也限制了其通用性,算法一旦改变,计算能力会大幅下降,需要重新定制。

不过,随着数据量的不断增加和芯片工艺的极限到来,对算力的诉求越来越难以被满足。在此背景下,对于一些特定的领域,其数据量庞大,算法逐渐固定,使用专为特定算法设计的ASIC芯片成为了许多公司的首选。如TPU、NPU等,都是ASIC专用芯片。

国内云端主流ASIC芯片厂商及最新产品动态

来源:与非网研究院

根据Linley Group的预测,AI加速芯片总体营收将从2019年的44亿美元,达到2024年的150亿美元,年增长率(CAGR)为28%。而服务器领域占据最大市场规模,预计将从2019年的营收超30亿美元,到2024年将接近100亿美元,届时,近一半的新服务器(以及大多数云服务器)将包含AI加速芯片。

当前,提高处理器的性能在数据中心和边缘都很重要,一些不同类型的体系架构正在探索推理和训练的应用。数据中心/HPC、云边协同的应用场景,围绕以上芯片架构的异构计算体系正在形成,这也将进一步刺激AI芯片的创新发展。

边缘场景潜力巨大

人工智能芯片不仅可以部署在云端,还可以应用于多种网络边缘设备,如智能手机、汽车自动驾驶以及智能摄像头等。应用于网络边缘设备的人工智能芯片多为推理芯片,且专业程度越来越高。到2022 年,人工智能推理芯片市场的规模预计将增至20亿美元,复合年均增长率达到40%。

智能汽车进入高算力时代

汽车的智能化是AI芯片的理想应用领域,它不仅仅是一个复杂的AI应用场景,且对于实现无人驾驶具有重要的意义。传感、建模与决策是三大必备流程,每一个流程都涉及推理芯片应用。而无论是环境传感或障碍物躲避,都对AI芯片的计算力都提出了很高的要求。

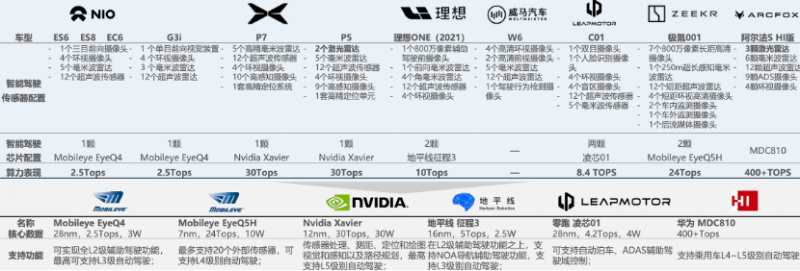

2021年新势力与领先自主品牌车企代表车型及算力配置

来源:亿欧智库

国内汽车AI芯片主流企业

来源:与非网研究院

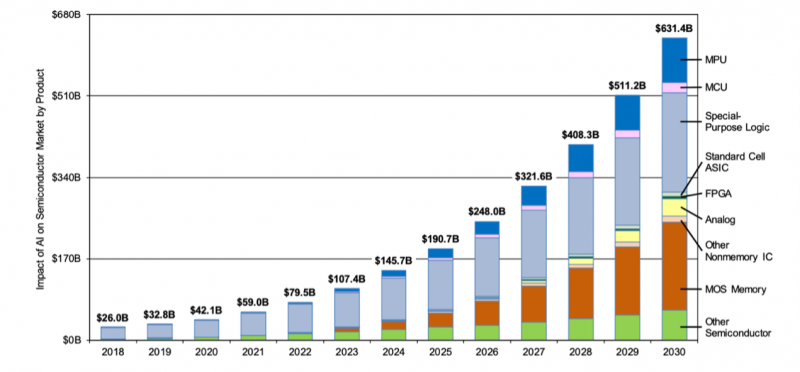

攫取元宇宙第一风口XR机遇

元宇宙的实现需要庞大而复杂的底层技术。从环节上划分,主要可以分为网络通信、数据处理、图像渲染、虚实交互、资产加密交易,而这些环节基本都需要AI技术的赋能。

元宇宙的第一个风口就是VR/AR,因为沉浸式的交互体验在元宇宙的构建中是必不可少的一部分,而目前手机电脑等移动外设设备无法为玩家提供全方位的身临其境的体验感。VR虚拟现实能够让用户进入全仿真环境,全面连接玩家的视觉,听觉和触觉,并通过动作捕捉来实现信息的传入和导出;AR增强现实则能让虚拟世界与真实世界共同存在且相互融合。

AI技术有助于提升XR内容制作和实时图形渲染效率、呈现更真实高质量的画面体验,使XR 所开发出来的各种应用和对应配套工具更具竞争力,并将驱动对更高算力(从底层芯片到 AI 服务器、数据中心) 的需求。

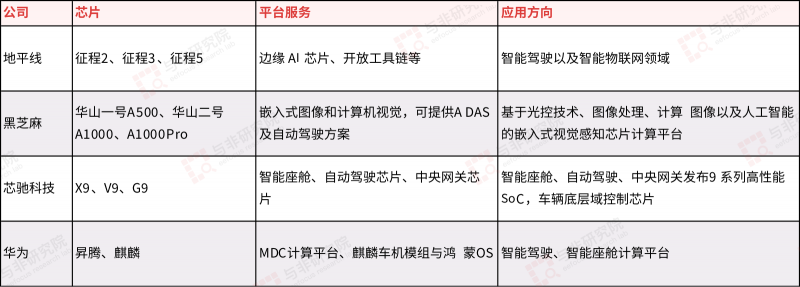

从终端出货情况来看,2021上半年全球VR头显出货量为430万台,其中Facebook Quest 2 产品销量约为350万。AR头显出货量为28万台,AR目前基本处于B端市场,头显出货量小。而不论是VR还是AR头显,2022年是迎来高增长的重要节点,都将促进相关AI技术的落地应用。

全球VR/AR头显出货量趋势

来源:VR陀螺

AI是半导体未来十年关键催化剂

AI是未来十年半导体市场增长的关键驱动因素之一,相应的,半导体公司也需要制定人工智能的相关战略。

根据IBS的预测,2030年,半导体市场预计为11933亿美元,而2020年为4461亿美元,复合年增长率为10.34%。随着AI应用的增加,数据使用量急剧增加等,导致2020年至2030年这十年间半导体市场的增长高于2010年至2020年。

下一个十年,半导体领域已经发生的兼并和收购,也将使一些半导体供应商获得了更多的定价权,这也会对半导体市场的增长产生积极影响。此外,人均半导体产品消费量的增长也促进了半导体市场的增长。

同时,生成的数据量继续急剧增加。数据流量约占生成数据总量的5%,其余95%要么在边缘处理,要么丢失。数据流量的增长,多个来源生成的大量数据需要处理,使人们看到数据在社会活动中越来越大的作用,这也将使AI进一步凸显价值。随着AI能力的提高,对数据的需求也越来越大,这也推动了AI的持续增强,同时带来对更多数据的需求,这为应用广泛的半导体产品提供了机会,其战略价值也在不断提升。

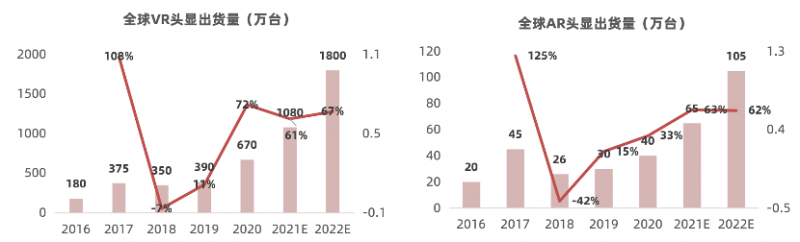

近十年间AI对半导体市场的影响

来源:IBS

尽管AI对半导体的影响因产品而异,但随着时间的推移,影响逐步增大。2020年,AI对半导体的贡献总额为421亿美元,但到2030年将达到6314亿美元,复合年增长率为31.11%。

从细分产品来看,不论该类别产品市场份额大小,自2022年开始明显逐年上扬,包括处理器和存储、模拟等在内,AI功能和支持AI算法,对其未来参与半导体市场的许多领域至关重要。

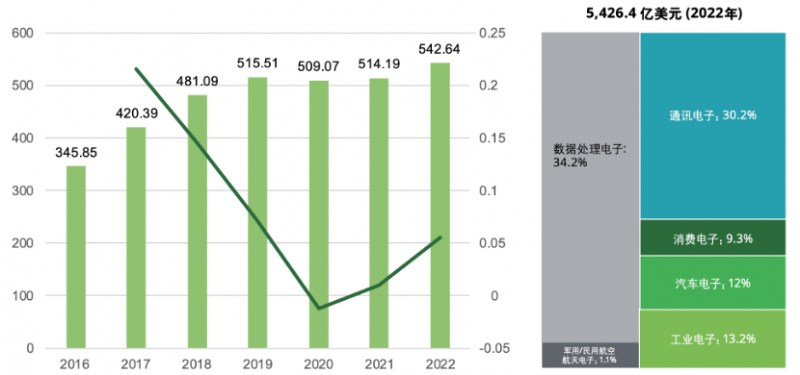

再从2016年-2022年全球半导体行业销售收入情况来看,全球半导体行业总收入将从2016年的3458.5亿美元,增长到2022年的5426.4亿美元。占据最大市场规模的将是数据处理电子(34.2%),其次分别是是通讯电子(30.2%),工业电子(13.2%),汽车电子(12%)。在半导体行业中占据主导地位的这些领域中,AI都是重要的驱动力量。

全球半导体行业销售收入(2016-2022年,单位:十亿美元)

来源:Gartner、德勤

未来的三大挑战

在已经爆发或即将爆发的领域,AI潜力巨大,但同时面临发展挑战。当前AI应用to B/to G色彩浓重,例如在金融、零售、数字政务等领域实现了广泛应用,下一步,在智慧医疗、智能驾驶、智慧教育领域增长潜力较大,但是,在全产业和细分下沉应用拓展上主要面临三大挑战:

第一,标准化软件工具不可或缺,半导体企业对标准的开源软件框架的支持程度是市场竞争的关键,特别是对于试图追赶半导体芯片领先企业的挑战者尤其如此。因为头部企业已经支持几乎所有深度学习软件和工具,后来者要在市场竞争中存活下来,至少要能够支持主要的开源软件框架,如 TensorFlow、Caffe2、Theano、CNTK、 MXNet 和Torch等,同时还需为开发者提供辅助应用开发的工具。此外,对于半导体芯片供应商、半导体系统公司而言,与现有的软件开发任务相比,AI需要新的技能体系,因此更需要建立强大的软件开发组织来应对未来的AI趋势。

第二,过去几年,AI面向政府和行业应用快速落地,下一步,在AI从云端迁移至边缘的机遇不断增多,很多大型企业正在从云端转移至边缘,以提供从训练到推理工作的全方位人工智能解决方案。这势必带来网络架构、计算架构的新变革,半导体企业应该通过更多创新,推动AI从云端向边缘的下沉。

第三,跨行业平台生态以及面向垂直细分市场的定制化方案能力,仍将对AI企业特别是初创公司带来挑战。

1391

1391

下载ECAD模型

下载ECAD模型