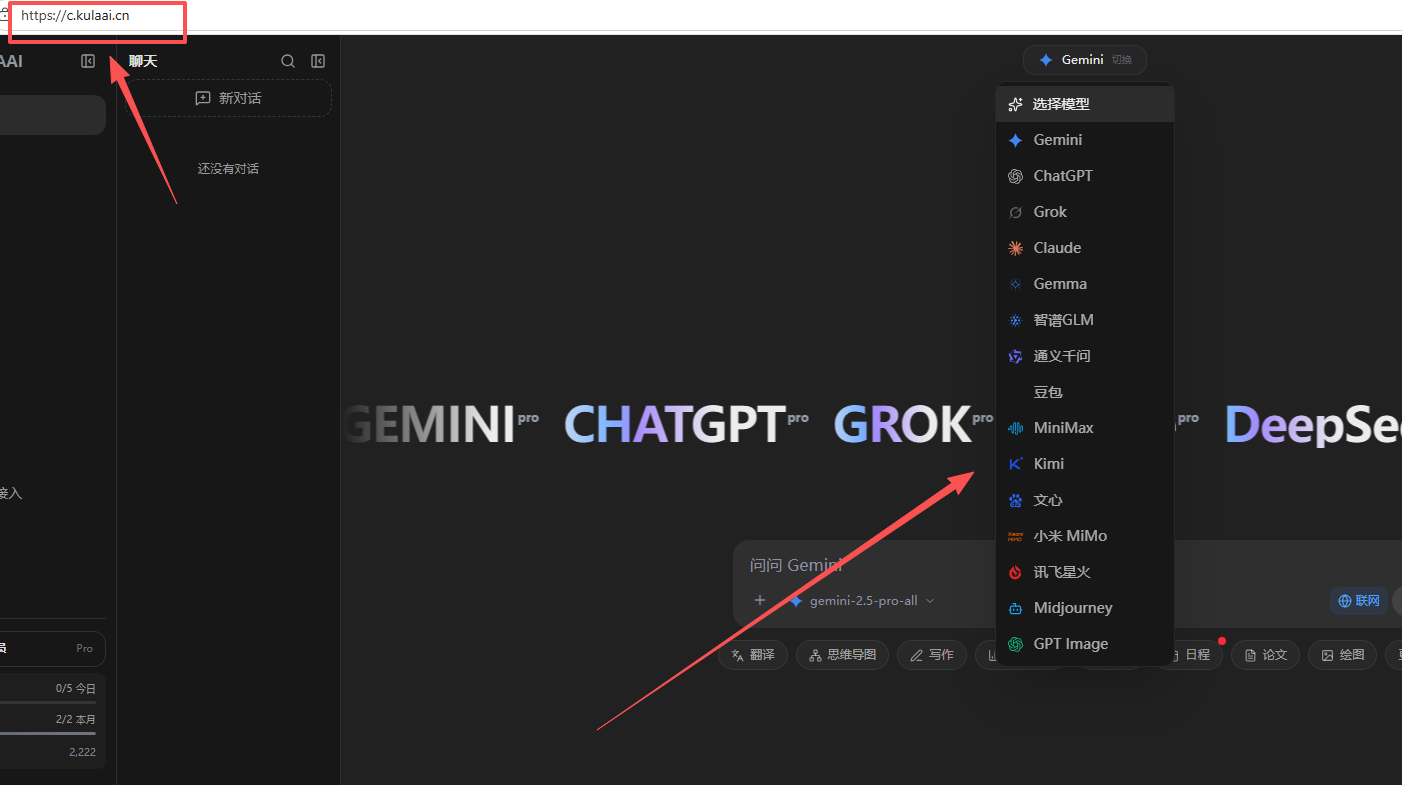

刚开始接触多个AI模型的开发者,可以先用聚合平台库拉c.kulaai.cn,一个页面同时体验各家模型,省去逐一注册的麻烦。

2026年Q1大模型圈很热闹。Gemma 4上周开源,覆盖2B到31B多个规格;DeepSeek年初上了百万token灰度;GPT-6的传闻也开始冒头。对想系统学习主流大模型的开发者来说,现在是入门的好时机,但也容易被信息淹没。

这篇文章聊聊我自己的学习路径,尽量讲实操,少讲废话。

第一步:先搞清楚主流模型的格局

2026年大模型大致分三个梯队:

闭源头部:GPT-5.4、Claude Opus 4.6、Gemini 2.5 Pro。性能最强,API调用为主,个人没法本地部署。

开源主力:DeepSeek V3.1、Gemma 4系列、通义千问Qwen2.5。可以本地跑,可以微调,社区活跃。

轻量本地:Llama 3、Mistral、Phi-3。能在消费级显卡上跑,适合学习架构和做实验。

建议从开源模型入手。原因很简单:能看代码、能本地跑、能改参数。闭源模型再强,你只能调API,学不到底层东西。

第二步:本地部署,动手跑起来

学大模型最忌讳只看不动手。哪怕显卡只有8G显存,也要跑起来感受一下。

入门方案:用ollama或vLLM部署一个7B参数的模型。Llama 3 8B或Qwen2.5 7B都行,一张RTX 3060就能跑。体验一下推理速度、显存占用、输出质量,心里就有数了。

进阶方案:上Gemma 4 7B或DeepSeek 7B,对比同一问题在不同模型上的输出差异。这一步的目的不是找"最强",而是建立对模型特性的直觉。

硬件不够?用CPU推理也行,就是慢。学习阶段体验大于性能,别被硬件门槛挡在门外。

第三步:学会提问,比学模型更重要

很多人用AI效果差,不是模型不行,是prompt没写好。

几个实用原则:给足上下文,别让模型猜。指定输出格式,比如表格、列表、代码块。分步提问比一次扔一堆问题效果好。给一个示例让模型模仿,准确率提升明显。

建议拿同一个任务,分别用GPT、Claude、Gemini、DeepSeek跑一遍。你会发现同样的prompt在不同模型上效果差异很大。这种对比经历比任何教程都管用。

第四步:理解架构差异,但别钻牛角尖

Transformer是基础,这个必须懂。注意力机制、位置编码、KV Cache这些概念,花一个周末看几篇博客就能搞清楚。

但不需要从头手写一个Transformer。2026年的趋势是工程能力比理论深度更值钱。知道不同模型的架构差异(比如MoE和Dense的区别、稀疏注意力和滑动窗口的作用),能帮你做更好的选型决策就够了。

推荐几个学习资源:Andrej Karpathy的视频系列讲得清楚,适合入门。知乎和掘金上有很多中文实战帖,遇到具体问题直接搜比啃论文快。

第五步:微调和RAG,这是分水岭

只会调API和会微调/RAG,是两个层次的开发者。

微调入门:先用LoRA在小数据集上跑一遍。选一个7B模型,准备几百条数据,跑通整个流程。不需要效果多好,重点是理解数据准备、训练参数、评估指标这些环节。

RAG入门:搭一个简单的检索增强生成系统。用向量数据库存文档,用户提问时先检索相关内容,再喂给模型生成回答。这是目前工程落地最广的方案,值得深入学。

DeepSeek和Gemma 4都是很好的微调实验对象,开源社区有大量现成的教程和工具。

第六步:关注生态,别只盯模型本身

2026年大模型竞争已经不只是模型能力的比拼,更是生态的较量。

Google把Gemma 4开源后配套了完整的工具链。DeepSeek的社区生态在国内最活跃。OpenAI的GPT Store和插件体系在应用层做得最成熟。

学习的时候要同时关注推理框架、向量数据库、Agent框架这些周边工具。模型再强,没有好的工程化方案也落不了地。

学习节奏建议

第一个月:搞清楚模型格局,本地部署一个7B模型跑通,学会写有效的prompt。

第二个月:对比三到四个主流模型的差异,开始接触微调和RAG。

第三个月:找一个真实项目落地,解决实际问题。在实战中发现知识缺口,再针对性补。

不要追求一次学完所有东西。大模型领域迭代太快,保持学习习惯比一次性掌握更重要。

写在最后

2026年学大模型的门槛比两年前低了很多。开源模型质量大幅提升,部署工具越来越傻瓜化,教程资源也丰富了。

关键是动手。别光看测评和排行榜,自己跑一遍项目、调一次模型、搭一个RAG系统,体感就全来了。

遇到问题多逛社区,多和同行交流。这个领域变化快,闭门造车学不深。

芯耀

芯耀

1453

1453