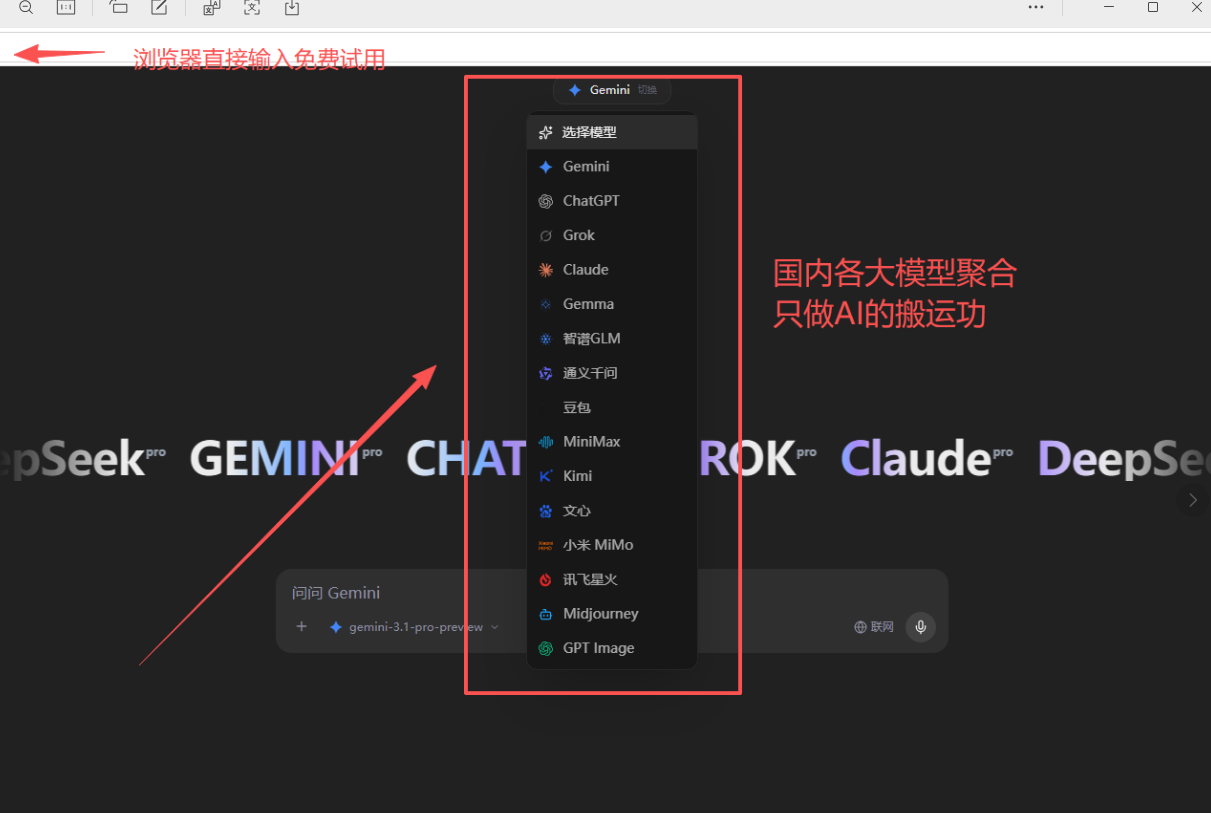

最近一直在用库拉AI(c.kulaai.cn)这个聚合平台,Gemini、Claude、GPT几个主流模型在一个界面切换,省了不少来回折腾的功夫。借着这个机会,把我这两个月用Gemini踩过的坑和总结的经验一次性讲清楚,新手照着来能少走很多弯路。

一、先说结论:Gemini到底值不值得用?

2026年的Gemini和一年前完全是两个东西。

谷歌这一年没闲着,从2.5 Pro到3.0,再到上个月发布的Gemini Embedding 2多模态嵌入模型,迭代节奏快得有点吓人。最直观的变化是两个:推理能力肉眼可见地提升了,多模态处理终于不再是PPT上的功能。

但问题也在这——版本太多,入口太杂,新手踩坑的概率极高。

二、注册和入口:别再走弯路

Gemini的入口分好几个版本,很多人上来就懵了。

网页版:浏览器直接用,适合轻度体验

App端:安卓和iOS都有,功能比网页版完整

API接入:开发者用的,需要Google Cloud账号

新手从App或网页版开始就行。注册需要Google账号,这一步没有捷径。网上那些"免注册教程"基本都是引流的,别浪费时间。

注册完第一件事:开启Gemini Activity(活动记录)。很多人忽略这一步,导致每次对话都是全新上下文,体验直接打对折。

三、提示词才是核心:别把Gemini当搜索引擎用

新手最常犯的错——把Gemini当百度用,丢几个关键词就等结果。

Gemini是推理模型,不是搜索引擎。你给的信息越具体、结构越清晰,返回质量越高。

错误写法:"帮我写个Python爬虫"

正确写法:"我需要一个Python爬虫,目标网站是豆瓣电影Top250,要求:1.用requests+BeautifulSoup;2.提取电影名称、评分、一句话简介;3.结果保存为CSV;4.加入随机延时防止被封"

差别在哪?后者给了约束条件。Gemini天然适合有边界的任务,你给的边界越清晰,它越不容易跑偏。

另外2026年新增了"思维签名"功能,设置里打开之后能看到推理过程,对学习和调试提示词帮助很大。

四、多模态能力:这才是Gemini的杀手锏

2026年各家都在卷多模态,但Gemini的原生多模态架构确实有优势。

简单说,它不是"拼凑式"处理图文——文本、图像、音频、视频在同一个表征空间里联合建模。翻译成人话:理解更准确,跨模态转换更自然。

实测几个场景:

图片分析:丢一张复杂PPT截图进去提炼要点,准确率比去年高了一个档次

手写代码识别:拍照转代码,正确率90%以上

长文档处理:百万token上下文窗口,整本书喂进去也没问题

不过国内直接用原生Gemini有网络门槛,这也是聚合类平台存在的意义——统一入口,省去单独配置的麻烦。

五、常见误区,我替你们踩过了

误区一:版本越多越好?

Gemini有Nano、Pro、Flash、3.1 Pro好几个版本。新手不需要全了解,记住就行:日常对话用Flash(快且便宜),复杂推理用Pro,移动端用Nano。

误区二:对话越长越好?

不是。对话太长上下文会乱,回答质量反而下降。按主题建新对话,别把所有问题塞一个窗口。

误区三:一次提问解决所有问题?

复杂任务要学会拆解。"帮我做一个完整的商业计划书"这种需求,Gemini大概率给你一堆正确的废话。分步来:先列框架,再逐一展开。

误区四:生图直接用Gemini就够了?

Gemini的生图能力2026年已经成熟,但专业视觉输出还是建议搭配专门的生图模型。不同模型做不同擅长的事,这才是聪明的用法。

六、模型组合:2026年真正高效的工作方式

说句大实话:2026年还死磕单一模型的,基本都在用低效方式工作。

我的日常流大概是这样:

1.思路梳理 → Gemini Pro,推理强,适合结构化思考

2.代码生成 → 切到Claude,补全更精准

3.文案润色 → 用GPT-5系列,中文语感自然

4.图片分析 → 继续Gemini,多模态确实能打

关键是怎么切。在一个平台里无缝跳转,比开十几个浏览器标签页高效太多。这也是现在聚合平台越来越受欢迎的原因——主流模型集在一个入口,用哪个切哪个。

七、下半年AI圈会怎么走

几个明显的信号:

模型能力趋同:Gemini、GPT、Claude差距在缩小,未来拼的是生态和易用性

多模态是标配:纯文本交互正在被淘汰,下半年几乎所有严肃场景都要图文音视频联合处理

Agent化提速:从"一问一答"到"自主完成任务链",Gemini的自动化Beta已经开始了

平台稳定性比模型版本更重要:关注你用的入口靠不靠谱,比纠结用哪个版本实在

八、总结

Gemini在2026年的进步是实打实的,不是营销吹出来的。但它仍然有学习成本,提示词工程和版本选择这两块尤其明显。

新手建议:先从一个版本用透,再逐步扩展。 别急着把所有功能都试一遍,反而什么都没学会。

评论区交流,看到都会回。

芯耀

芯耀

6840

6840