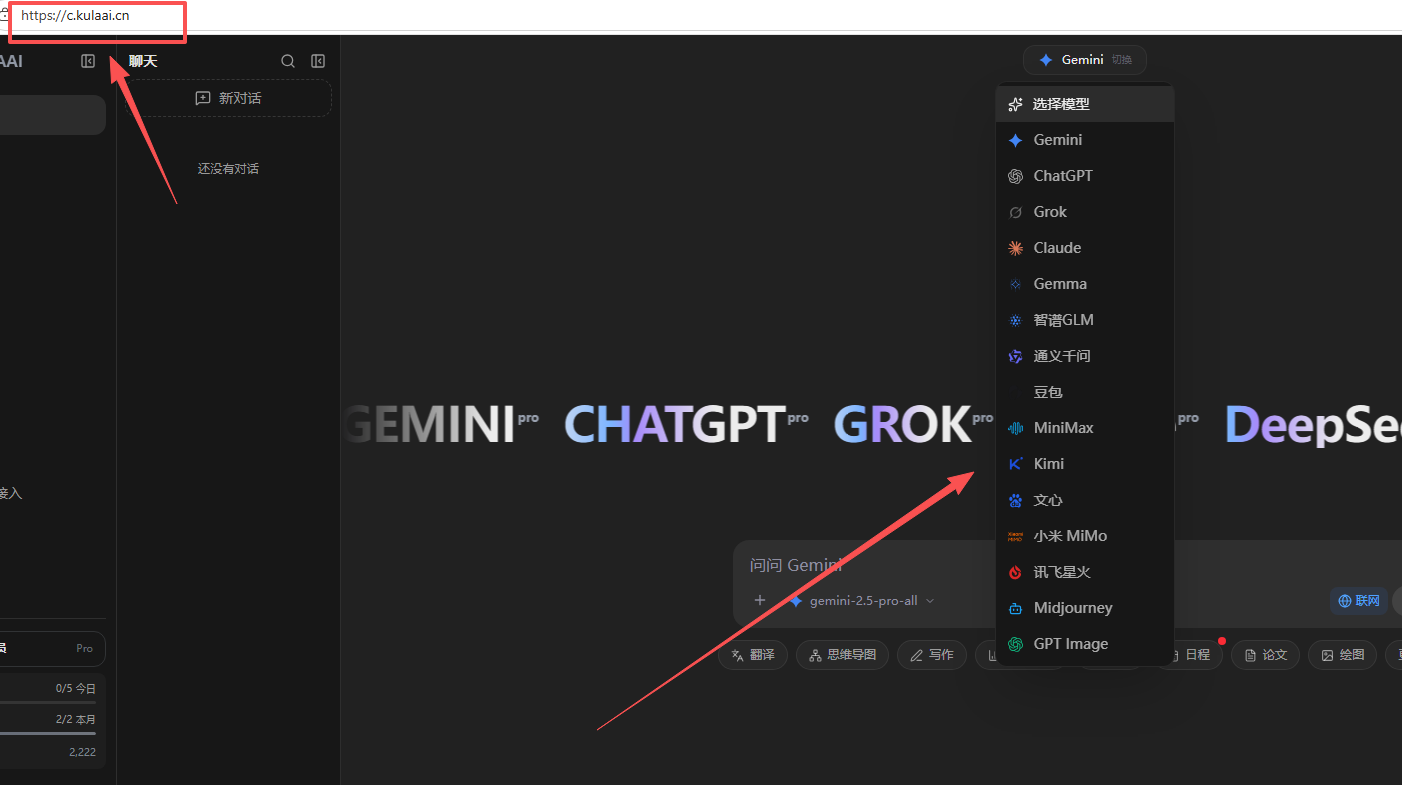

上个月在库拉AI(c.kulaai.cn)上调了Claude和GPT-5.4的API做代码生成对比测试,同步把Codex CLI也部署起来了。用了三周,把两个工具在实际开发中的差异梳理清楚,分享给正在选型的工程师朋友。

背景:AI编程工具格局已经变了

2026年AI辅助编程从"锦上添花"变成了开发流程的标配。目前主流路线有四条:Copilot做IDE内补全,Cursor做编辑器级整合,Claude Code走终端智能体路线,Codex定位云端软件工程代理。

对于国内开发者来说,选工具不只看能力,还得看接入成本和稳定性。这也是很多人从Claude Code转向Codex的核心原因。

Claude Code:推理强,但环境成本高

Claude Code基于Claude Agent SDK构建,能自动理解整个项目结构,读写文件、操作Git,把终端变成一个有思考能力的编程搭档。

长文本处理是它的强项。复杂算法、架构设计、多步逻辑推演这些场景,Claude Code生成的代码结构感强,边界情况考虑周全。有工程师用它从零搭建项目,三周下来反馈是"像一个需要盯但能干活的实习生"——这评价其实挺高。

但问题也很现实。国内网络环境下连接不稳定是老问题,需要配置代理环境变量才能正常访问。4月8号社区有人反馈升级到2.1.94之后AWS兼容出了问题。工具本身的基础稳定性都没保障,对需要持续交付的工程团队来说是个隐患。

另外生态相对封闭,插件和工具链少,出了问题找解决方案的效率不高。

Codex:可用性高,接入更顺

OpenAI的Codex走的是另一条路——云端软件工程智能体。GPT-5.3-codex和GPT-5.4模型加持,256K上下文窗口,对大规模代码库的理解能力有了质的提升。

3月31号OpenAI放出了codex-plugin-cc,一个专门给Claude Code用户的Codex插件,Apache-2.0开源,半天3200 star。社区的反应说明很多开发者已经在寻找替代方案了。

实际用下来,Codex有几个明显优势:

代码可用性高。GPT-5.4生成的代码接近生产级别,基本review一下就能用,二次修改量很少。在迭代密集的工程场景里,这个优势能直接转化为交付速度。

生态成熟。插件丰富,社区文档和教程多,遇到问题能快速定位。API集成方案成熟度高,做业务对接省心。

接入方案灵活。国内通过聚合API调用,稳定性明显优于Claude Code直连方案。不需要折腾代理环境,配置过程更简洁。

在代码审查和安全漏洞检测方面,Codex的表现也优于Claude Code,GPT-5.4对安全性的理解深度有明显提升。

安装流程

环境要求先准备好Node.js,版本18以上即可。

第一步,通过npm全局安装Codex CLI包,一行命令搞定。

第二步,设置两个环境变量:一个是API Key,另一个是国内环境下需要的接入地址。这两个配好之后基本就不用再动了。

第三步,终端里输入codex加版本号参数验证安装。看到版本号输出就说明成功。

第四步,在项目目录下直接启动codex进入交互模式,用自然语言描述需求,工具自动读取项目上下文生成代码。

整个过程比Claude Code配置代理折腾环境变量的方案顺畅不少,五分钟之内能跑起来。

基准对比:各有侧重

从已有评测看,Claude Code在复杂推理基准上依然领先,特别是需要深层逻辑推演的任务。Codex在代码审查、安全检测、生产可用性上更强。

简单任务两者差距不大,复杂场景各有舒适区。不存在全面碾压的情况。

我的选型策略

复杂算法、架构方案、需要深度推理的审查任务——Claude Code。推理深度优先。

日常开发、快速原型、项目集成、团队协作——Codex。可用性和稳定性优先。

最理想的方案是两个都接入,通过聚合API统一管理。任务类型决定走哪条路径,配置一次自动路由,不需要手动切换。这也是我目前在跑的方案,开发体验比单独用任何一个都流畅。

趋势观察

AI编程工具正从"补全"向"代理"演进。单一工具很难覆盖所有工程场景,多模型协同是确定性方向。能把多个编程AI整合到统一工作流里的方案,会在工程师群体里跑出最高渗透率。

以上是三周实际使用的总结,欢迎交流不同体验。

芯耀

芯耀

1.3万

1.3万