先聊背景:为什么工程师现在要看Gemini?

过去两周AI圈的密度高得离谱。GPT-6代号"Spud"预训练完成,定档4月14日发布。DeepSeek V4同期登场,多模态和长期记忆是重点方向。百度刚官宣Create 2026开发者大会五月落地北京,"芯-云-模-体"全栈布局要正式亮相。Claude那边更猛,Mythos版本据说能挖出潜伏27年的代码安全漏洞。

这些动态背后有个共同趋势:2026年大模型的战场已经从"谁参数多"转向了"谁落地快"。中国AI大模型市场今年预计达到680亿元,边缘AI芯片市场规模去年已经突破420亿美元。芯片端和模型端同时加速,意味着工程师需要快速评估不同模型在具体场景下的表现。

Google的Gemini Embedding 2上个月发布,原生多模态嵌入加上256K上下文窗口,在长文档解析、多模态理解、代码审查这些任务上有明显差异化。但Google服务在国内没有直接通道,所以接入方案的选择就很关键。

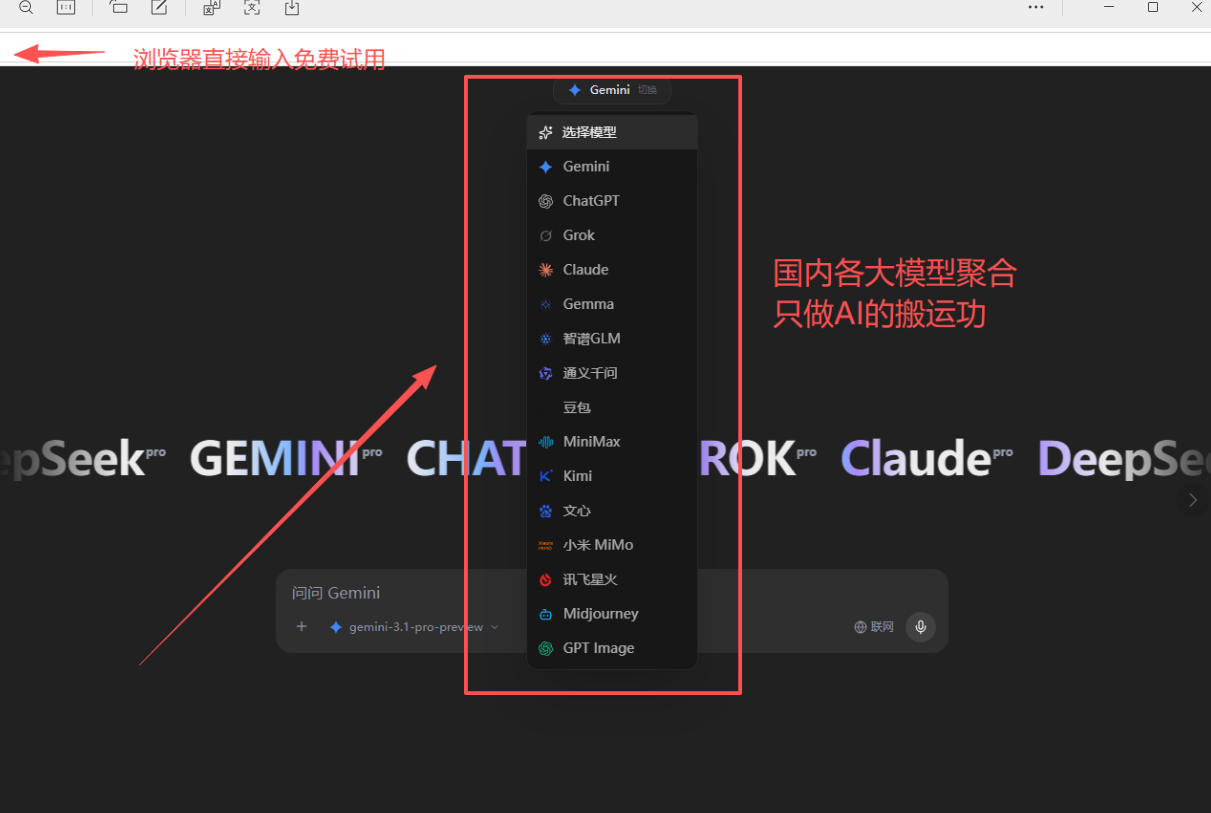

方案一:国内聚合平台,验证最快

适合场景:快速做模型对比测试、验证prompt效果、评估不同模型在你的任务上的表现差异。

这类平台把Gemini、Claude、DeepSeek等模型做成了统一入口。一个输入,多个输出,直接做A/B对比。

我自己的用法是这样的:做方案初稿时,同一个prompt丢给三四个模型,看哪个的逻辑结构最清晰、哪个的措辞最精准,然后在那个基础上精修。比一个人反复改效率高很多。

选平台主要看三件事:模型版本是否跟进最新、响应延迟在不在可接受范围、长上下文窗口有没有被阉割。如果你的需求主要是文本类任务——写方案、做摘要、技术文档翻译——这条路完全够用,不需要额外技术投入。

方案二:API转发,集成到自有系统

适合场景:需要把AI能力嵌入自己的产品、做自动化流程、或者批量处理任务。

原理不复杂。第三方提供一个API网关,你的请求走这个网关转发到Gemini后端。代码层面只需要改一个base_url,其他接口格式保持兼容。OpenAI风格的SDK直接能用,Python十几行代码跑通。

我之前用这种方式做过一个批量代码审查的脚本,把项目里的代码片段逐个丢给Gemini做静态分析,效果比单条手动测试好太多。配合环境变量管理API Key,安全性也没问题。

几个工程上的注意事项:计费方式各家不一样,有的按token有的按请求次数,接入之前先算清楚月度成本。转发服务的稳定性要看服务商的SLA,关键业务建议做降级预案。另外注意输入输出的数据合规性,敏感业务数据不要直接丢到外部API。

这条路适合有一定开发能力的团队。灵活度高,想怎么集成都行,成本也相对可控。

方案三:原生Google AI Studio,能力最全

适合场景:对模型能力有极致要求、做前沿技术预研、需要最新版本的完整功能。

Google AI Studio支持Gemini全系列模型,3.1 Pro的完整能力只有在这里才能体验到。网页端可以直接调试prompt,API调用也支持。

优势很明确:版本最新、上下文完整、多模态能力没有被裁剪。代价也很直接:网络环境是第一道坎,付费成本是第二道。免费额度有限,重度使用需要绑定付费。如果你同时在用好几个平台的API,月度开销加起来不低。

我的建议是,除非你在做深度技术预研或者对模型参数有硬性要求,否则不用all in原生方案。成本收益比不高。

三方案横向对比

| 维度 | 聚合平台 | API转发 | 原生方案 |

|---|---|---|---|

| 技术门槛 | 极低 | 中等 | 较高 |

| 模型版本 | 通常滞后1-2个版本 | 看服务商 | 最新 |

| 成本 | 按平台定价 | 按量计费,可控 | 免费额度+付费 |

| 灵活度 | 低 | 高 | 最高 |

| 适用场景 | 日常对比、轻量任务 | 项目集成、批量处理 | 前沿研究、极致需求 |

趋势判断:2026年Q2的关键变量

从产业角度看,几个信号值得关注。

一是模型能力趋同化。GPT-6、DeepSeek V4、Gemini 3.1在基准测试上的差距在缩小,差异化越来越体现在生态和垂直场景上。这意味着选模型不必执着于"最强",而是看"最适合你的任务"。

二是边缘部署加速。边缘AI芯片今年的市场增速超过预期,端侧轻量化模型正在从实验室走向量产。对工程师来说,云端大模型和端侧小模型的协同架构会是接下来的重点课题。

三是国产模型的追赶速度。DeepSeek V4四月发布的预期很强,百度全栈布局五月落地,国内模型在中文理解和本土化场景上的优势越来越明显。如果主力任务是中文内容处理,国产模型的性价比已经非常高。

我的选择逻辑

日常对比测试用聚合平台,零门槛,拿来就用。项目集成走API转发,灵活度够,成本可控。极少数需要验证最新能力的场景才去碰原生方案。

工具选型没有标准答案。搞清楚自己最常做的三五件事,找到最高效的模型组合,跑起来比什么都重要。上面三个方案挑一个试一周,效果好不好自己会有判断。

芯耀

芯耀

1413

1413